Les 3 Lois de la Robotique par Asimov

Les 3 Lois de la Robotique d'Asimov

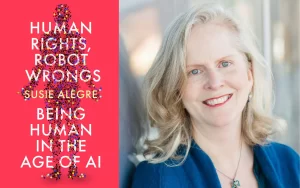

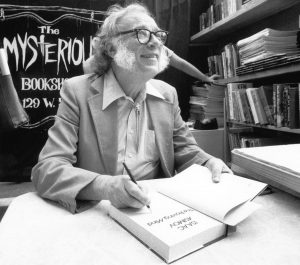

Isaac Asimov - auteur Américain de science-fiction

Isaac Asimov, auteur d’origine russe, qui a grandi à Brooklyn, est devenu professeur de biomédecine à l’Université de Boston et a quitté son poste d’enseignant pour devenir un écrivain de science-fiction à plein temps.

Le terme «robot» lui-même est emprunté à un autre écrivain, le tchèque Havel Čapek, qui, en 1920, a publié une pièce de théâtre intitulée R.U.R. Rossum’s Universal Robots. Rossum étant une entreprise high-tech de l’époque qui construisait des “robota”, machines, capables de faire le travail des humains.

En 1950, Asimov publia un recueil de 9 histoires courtes I, Robot, désormais culte, d’où sont tirés les Trois Lois de la Robotique ou Les Trois Lois d’Asimov.

Toutes les histoires impliquent des robots qui se comportent de manière inhabituelle et contre-intuitive (pour les robots) comme ils sont conscients et ont des émotions. Ils suivent un code éthique : les bientôt célèbres 3 Lois de la Robotique.

De nos jours, les trois lois de la robotique ne sont ni plus ni moins un code d’éthique généralisé pour les roboticiens, les concepteurs, les ingénieurs ou toute personne impliquée dans l’IA.

Il est assez remarquable et amusant de voir que tout le mouvement robotique est sémantiquement basé sur la littérature, sur la science-fiction.

I, Robot, a un sous-titre rarement mentionné qui néanmoins est des plus révélateurs:

“Le Jour des Hommes Mécaniques – Des aperçus prophétiques d’un lendemain étrange et menaçant.”

Les 3 Lois d'Asimov - 3 Lois de la Robotique

Dans la nouvelle Runaround, Asimov expose les 3 lois fondamentales de la robotique

Trois Lois de la robotique d’ASIMOV

- Un robot ne peut pas blesser un être humain ou, par inaction, permettre à un être humain de se blesser.

- Un robot doit obéir aux ordres qui lui sont donnés par les êtres humains, sauf lorsque de tels ordres entreraient en conflit avec la première loi.

- Un robot doit protéger sa propre existence tant qu’une telle protection n’est pas en conflit avec la première ou la deuxième loi.

Plus tard, une 4e loi sera ajoutée par Lyuben Dilov, philosophe bulgare

4. Un robot doit établir son identité de robot dans tous les cas.

Et une 5e loi par Nikola Kesaroski, un écrivain de science-fiction bulgare basé sur son livre The Fifth Law (1983)

5. Un robot doit savoir qu’il est un robot.

L'origine du mot "robot" vient de Karel Čapek, l'écrivain de science fiction tchèque

«Robota» en tchèque signifie «servitude», «travail forcé» ou «corvée». L’idée principale des histoires de Čapek est que les robots sont destinés à faire le travail de l’homme.

Jusqu’à ce qu’ils se rebellent.

R.U.R. raconte l’histoire d’une entreprise – Rossum – pionnière dans les dernières sciences, biologie, chimie et physiologie qui entame la production de masse de nouveaux travailleurs qui «ont tout sauf une âme». Les robots effectuent tous les labeurs des humains et, bientôt, l’entreprise est inondée de commandes.

Dans les premières ébauches de sa pièce, Čapek a nommé ces créatures labori, du latin labor, le travail; or il craignait que le terme ne paraisse trop «intellectuel» et a choisi le terme “robota” plus ordinaire, sur la suggestion de son frère, Josef Čapek.

Le hype autour des robots, un phénomène moderne?

Certainement pas.

Avant que le mot robot ne soit utilisé, l’idée d’une entité autonome ou mécanique hantait déjà l’Homme.

Le monde antique était fasciné par les êtres artificiels. Dans la mythologie grecque, le dieu du feu, Hephaistos crée Talos, un géant de bronze. Dans la Renaissance, Léonard de Vinci conçoit une mécanique qui bouge ses bras et sa tête et se lève …

Il y avait plusieurs manières d’exprimer l’idée de constructions mécaniques.

Le concept ancien des êtres artificiels n’était pas centré sur l’intelligence mais plutôt sur le côté mécanique.

- Androïd (13ème siècle) – est un robot humanoïde

- Automate (17ème) – machines autonomes telles que les humains mécaniques, les jouets mécaniques, les modèles astronomiques en mouvement et les musiciens mécaniques

- Robot (20ème siècle Čapek) – est une entité autonome, non biologique (c’est-à-dire artificielle)

- Cyborg est une entité qui combine des composants artificiels/technologiques et biologiques

Les conceptions mécaniques de Leonard de Vinci

Devons-nous mettre à jour les Lois d’Asimov?

Pour entamer cette réflexion, il est utile de catégoriser les robots par leur utilisation en catégories d’usage: les robots de service, les robots industriels et les robots militaires.

Il semble alors plus clair qu’un robot-aspirateur tel Roomba n’a pas besoin d’être considéré comme un robot potentiellement dangereux auquel s’appliquerait Asimov. Si tel était le cas, une voiture ou un lave-vaisselle devrait l’être également.

À l’autre extrémité du spectre, cependant, il y a les robots militaires. Ces dispositifs sont conçus à des fins d’espionnage, d’élimination de bombes ou de transport de charges, tout cela au nom d’un mission militaire. Une mission par définition est de sauver, protéger ou défendre un pays, son peuple.

Mais “se défendre” d’un côté équivaut peut-être à “attaquer” pour l’autre côté. Si le meurtre ne devrait jamais être autorisé selon la déontologie de Kant, c’est pourtant la première nécessité dans certains cas, pour la protection d’un peuple sous l’attaque.

Et pour les drones militaires tueurs hackés, dans certains cas, est-ce que les hacker serait éthiques sous certaines conditions? Ou est-ce que cela reste toujours un piratage répréhensible ou, au contraire, cela deviendrait-il une action de sauvetage? Si l’on demande aux militaires, la réponse est toujours univoque.

Peut-être pourrions-nous aussi nous tourner vers la sémantique pour clarifier le concept. Que signifie to harm donc nuire utilisé par Asimov?

Est-ce un dommage physique ou un préjudice psychologique? Prenons l’exemple des robots-compagnons.

Dans le film HER de Spike Jonze, Theordore, un webdesigner, joué par Joaquin Phoenix tombe amoureux d’une IA.

Le code contre le coeur

Elle communique uniquement par la voix (Scarlett Johansen). Joaquin Phoenix tombe lentement mais sûrement amoureux de cette présence vocale, drôle, spirituelle et toujours pareille à elle-même.

Au début, tout va bien. Ils s’amusent, rigolent, se racontent leur journée, comme un vrai couple. L’IA lui raconte même des blagues pour lui remonter le moral, du genre : “C’est qui mon père?” – “Les data.”

L’idylle fonctionne bien. Puis progressivement, Théodore comprend qu’il n’est pas exclusif pour le programme d’IA.

Cette romance réelle pour lui, n’est que du virtuel pour la voix, que des données à l’état brut. C’est l’interprétation de Théodore qui change le flirt en romance, toujours platonique.

D’un côté des données traitées en input/output et de l’autre les mots chargés de sens. D’un côté, des mots prononcés, de l’autre, les mots ressentis et compris. C’est le code contre le coeur.

Alors, la question est : “L’IA lui a-t-elle fait du mal? Qui est responsable?

L’interface homme-machine, un problème éthique épineux

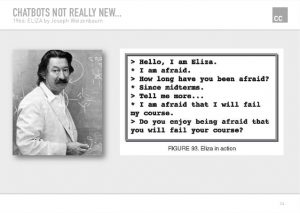

Joe Weizenbaum, le brillant professeur du MIT et inventeur du premier chatbot Eliza était dévasté en 1966, quand il a constaté l’extrême réaction que les personnes développaient face à son programme. Il était choqué de voir combien rapidement et profondément les gens devenaient dépendants de la machine.

Ses collègues à MIT, même sa propre secrétaire, jugeaient le programme à l’égal d’un interlocuteur fiable. Un véritable drame pour le scientifique pour qui Eliza avait été conçu comme un exercice de style, presqu’une blague de codage. Le nom Eliza était une référence à Eliza Dolittle l’héroïne de la comédie musicale My Fair Lady.

Une question de conséquences et de responsabilité

Le codage d’Eliza était des plus simples, mais l’impact psychologique considérable. Et le prélude à notre interaction continue et quotidienne avec les ordinateurs, apps et autres programmes.

Lors de chaque entretien que Weizenbaum donnait, il ne manquait pas d’insister que la seule chose qu’il regrettait dans sa vie était d’avoir inventé Eliza. Pour lui, c’était lui le responsable qui avait ouvert la boîte de Pandore.

Jusqu’à sa mort, il était un fervent défenseur de l’importance de la responsabilité dans tout acte de création, développement ou décision.

Pensez-vous que l’usage des robots devrait suivre plus de lois?