Interview avec… Merve Hickok – AIethicist.org / “100 Brilliant Women in AI Ethics 2021”

Interview avec... Merve Hickok

Fondatrice de AIethicist.org et nommée une des "100 Brilliant Women in AI Ethics 2021"

1) Quelle est votre définition personnelle de l’éthique?

Suivre sa boussole morale et ses valeurs pour faire ce qu’il faut même lorsqu’on est sous pression, ou même lorsque personne ne nous regarde, tout en respectant les expériences vécues par les autres et en développant activement nos connaissances. Merve Hickok

2) Vous avez fondé AIethicist.org. Parlez-nous en peu…

C’est un projet qui est né d’une frustration il y a des années, lorsque je cherchais (pour moi-même et ma propre volonté de comprendre) tous les problèmes liés aux systèmes de l’IA.

J’examinais alors les problématiques liées aux différents préjugés, à l’opacité des systèmes d’IA, aux principes et la manière dont ces principes se traduisaient en cadres de travail, etc. J’essayais d’avoir une vue d’ensemble, de comprendre différentes perspectives et de les distiller dans des contributions pratiques. Cependant, je me suis de plus en plus perdue dans l’immensité des recherches publiées.

Le domaine est relativement nouveau et l’on peut trouver tellement de nouvelles publications, qu’il était difficile de distinguer les contributions objectives des travaux promotionnels. Il y a aussi beaucoup d’articles techniques (naturellement) qui intimident les gens qui s’intéressent au domaine, mais ne savent pas par où commencer.

J’ai donc pensé que je pourrais rassembler une liste de recherches faites sur ces sujets pour aider d’autres personnes qui essayaient de mieux comprendre les concepts oud’aider ceux qui font réellement des recherches universitaires pertinentes.

AIethicist.org est un site Web vivant. Chaque mois, je mets le contenu régulièrement à jour. J’essaie également de distribuer mon propre travail (webinaires, podcasts, articles, etc.) et beaucoup de mes efforts sont orientés vers la sensibilisation et le fait de plaider des causes..

3) Vous avez choisi le substantif “ethicist” et non pas “ethics” pour le nom de votre entreprise.

Quelle est la signification de cette différence?

Je voulais mettre en évidence les décisions humaines et humaines derrière l’IA et les autres technologies disruptives.

Les systèmes d’IA n’ont pas leurs propres valeurs, décisions, boussole morale. Ce sont des artefacts de décisions et d’interactions humaines.

Je crois sincèrement que pendant que nous sommes dans cette phase de compréhension quant à l’impact de ces systèmes sur les individus, sur la société et sur nos institutions et pendant que nous essayons d’améliorer nos pratiques et nos produits, nous avons besoin de rôles dédiés dans les organisations. Cela ne veut pas dire que l’éthique est la responsabilité d’une seule personne au sein de l’organisation – bien au contraire. C’est la responsabilité d’un chacun, mais une fonction éthique dédiée pendant une période de transition peut aider à organiser et mobiliser des équipes, peut aider à conduire le changement plus rapidement, mieux et avec plus de responsabilité.

En fait, j’ai rédigé un descriptif sur cette fonction spécifique (ou ce à quoi cela devrait ressembler) dans une organisation https://medium.com/@MerveHickok/what-does-an-ai-ethicist-do-a-guide-for-the-why- le-quoi-et-le-comment-643e1bfab2e9.

Mon rêve le plus osé c’est un jour ce rôle, mon rôle, devient obsolète.

Une époque où nous aurions fait de tels changements dans nos organisations, dans la composition de nos équipes et dans nos interactions et pour tout ce que nous voulions optimiser que la question de l’éthique et la mise en avant de l’homme, des droits de l’homme ne seraient qu’une seconde nature pour tout le monde… l’essence-même de nos projets et produits.

4) Vous travaillez sur les biais et les discriminations par l’IA. Croyez-vous que l’IA sera capable de débarrasser l’homme de ce fléau proprement humain?

Une bonne chose dans le débat autour des biais et discrimination par l’IA a été le fait de comprendre que notre société est biaisée; que nos décisions concernant les données et les modèles ainsi que l’optimisation sont biaisées et que tout cela est lié au pouvoir. Certains des résultats scandaleux nous ont ainsi aidés à concrétiser ce dont nous discutions depuis toutes ces années, ces problèmes structurels de nos sociétés. En tant que développeurs, décideurs, décideurs politiques et législateurs, etc., nous devons désormais prendre des décisions conscientes. Voulons-nous utiliser ces systèmes pour verrouiller ces injustices structurelles et éventuellement les approfondir et les amplifier? Ou voulons-nous changer et transformer nos sociétés et nos institutions pour le mieux? Nous devons tous prendre la responsabilité d’imaginer un avenir meilleur, d’y travailler et de nous sentir responsables de ce que nous créons et utilisons (systèmes d’IA dans ce cas).

5) Où pensez-vous avoir les biais de l’IA les plus dangereux?

Tout domaine où il peut y avoir un impact sur la vie ou la qualité de vie d’une personne, l’accès aux ressources et aux opportunités. Le problème avec les systèmes d’IA ne concerne pas seulement les problèmes de biais, mais comment nous traitons les résultats de ces systèmes (qui sont nos propres biais, qu’ils soient intentionnels ou non).

Nous considérons les données comme une vérité de terrain objective, et les prédictions que le système avance comme des faits, comme des relations causales. Ainsi, lorsque vous commencez par ces fondamentaux problématiques et que vous les utilisez dans les domaines d’impact que j’ai mentionnés précédemment, les domaines d’application tels la justice, l’armée, les forces de l’ordre, les finances / crédit, le recrutement, la santé, l’éducation, etc. tous ces domaines deviennent des domaines à risque.

Ceci peut arriver pour des décisions de vie / mort dans certains cas, ou l’enfermement d’une personne / des groupes marginalisés dans des cercles vertueux de plus en plus profonds qu’il leur sera impossible de briser (par exemple, la notation du crédit, l’emploi, la police prédictive, etc.).

6) En quoi vous vous engagez-vous le plus?

La justice sociale et un avenir où la technologie n’est pas utilisée pour affirmer un pouvoir asymétrique. Un avenir où chacun profite de la technologie en définissant les technologies pour lui-même.

Une grande partie de mon travail consiste à sensibiliser sur les implications et les conséquences des pratiques actuelles avec les systèmes d’IA et les pratiques de données, puis sur la manière d’améliorer notre travail.

Ces systèmes ont un impact sur nos vies que nous nous définissons comme un consommateur, un citoyen ou un employé. Nous interagissons avec ces systèmes 24h / 24 et 7j / 7 mais ne comprenons pas forcément les conséquences. Par mon travail centré sur l’éthique, la gouvernance et les régulations, j’essaie de faire bouger le curseur le plus possible vers un point où ces systèmes et pratiques de l’IA ne doivent pas être acceptés comme inévitables, mais que nous remettons plutôt en question le cadre qui nous est imposé.

7) En quoi pensez-vous que la nouvelle proposition pour une régulation européenne de l’AI peut être essentielle?

Il s’agit du premier règlement global qui a en fait une chance de devenir loi à la fin. Nous avons vu la capacité de l’UE à changer le paysage avec le RGPD, et je pense que l’impact de cette proposition de loi sera encore plus substantiel. L’éthique est une gouvernance volontaire, il y a donc des limites à ce à quoi les entreprises et même les gouvernements s’engageront s’ils sont laissés à eux-mêmes.

Le marché ne peut pas s’auto-réguler pleinement de manière à protéger les droits de l’homme et à répondre à la justice sociale et aux préoccupations de la société. Les modèles commerciaux et les priorités entrent parfois en conflit avec ces concepts.

D’un autre côté, se fier uniquement à la loi et à la conformité ne suffit pas non plus. Nous avons besoin de l’éthique et de cette boussole morale pour remettre en question les technologies ainsi que le droit pendant que nos sociétés et nos réalités changent.

La proposition de règlement sur les systèmes d’IA, qui vient après des années de discussions au plus haut niveau sur l’éthique et les principes, etc., est donc la bienvenue. Il fournit également une certaine certitude et des lignes directrices aux entreprises. Il faudra encore quelques années pour que la législation proposée devienne loi et, espérons-le, certains des points controversés et / ou manquants de la proposition seront alors résolus.

8) Vous avez été nommé une des “100 Brilliant Women in AI Ethics 2021”. Qu’est-ce que cela signifie pour vous?

Ce fut un honneur absolu d’être élue sur la liste et d’être en compagnie de femmes extraordinaires œuvrant pour une technologie éthique et responsable dans leurs propres professions et activisme. La mission de Women in AI Ethics est d’accroître la reconnaissance, la représentation et l’autonomisation des femmes dans le domaine de l’éthique de l’IA. Ce sont des femmes qui imaginent un monde meilleur pour nous tous et qui sont passionnées par la justice sociale, l’équité et l’inclusion.

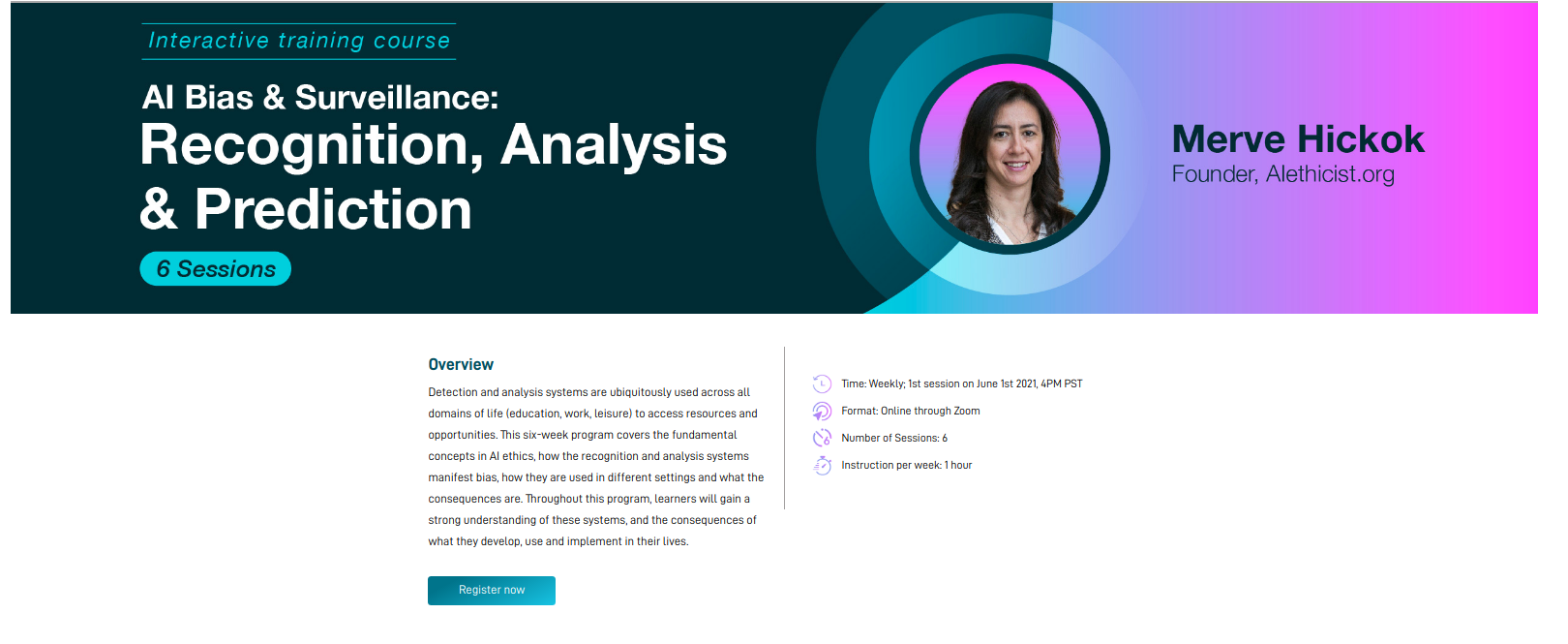

9) Vous allez proposer un nouveau cours en ligne à partir du 1er juin! Quel en est le sujet et en quoi sera-t-il pratique pour un chacun intéressé à l’IA?

C’est en fait mon deuxième cours en ligne avec RMDS Lab. Le premier cours est maintenant disponible en tant que cours à “rythme personnel” sur la même plate-forme. Il s’agissait d’un cours approfondi couvrant les principes fondamentaux de l’IA et de l’éthique des données, ainsi que les préjugés dans le cycle de vie des produits.

Le cours commence le 1er juin et couvre les concepts fondamentaux de l’éthique de l’IA dans une perspective de principes / droits de l’homme / réglementations; comment les systèmes de reconnaissance visuelle et faciales, des objets et du langage présentent des biais, et comment ils sont utilisés dans différents contextes et avec quelles conséquences.

La seconde moitié du programme se concentre sur les méthodes de surveillance et l’impact sur nos vies avec des discussions de cas pratiques sur le lieu de travail, l’éducation, les espaces publics, les espaces de consommation, etc. La dernière session est centrée sur des sujets similaires mais dans un contexte de la “maison intelligente” et de la “ville intelligente”.

Tout au long de ce programme, les participants vont acquérir une solide compréhension de ces systèmes et des conséquences de ces systèmes sur leur vie ainsi que des applications de justice sociale.

Les 2 cours sont indépendants l’un de l’autre et ne nécessitent aucune formation technique.

Lien vers l’inscription